Zwischen AI-Slop, Deepfake und Posting Zero: Bringt uns KI zurück zur Menschlichkeit?

Wenn KI das echte Leben täuschend echt nachbildet, aber das Vertrauen schwindet, gerät mehr ins Wanken als nur unser Blick auf Bilder und Videos. Unsere Autorin geht dem Gefühl der viralen Leere nach, das AI-Slop, Fake News und algorithmische Dauerbeschallung hinterlassen – und betont gleichzeitig die große Bedeutung von unabhängigem Journalismus, wirksamer Regulierung und gelebter Medienkompetenz.

Die Werbung einer Fast-Food-Kette kurz vor Weihnachten 2025 ist beispielhaft für das, was gerade passiert. Sie zeigte perfekt unperfekte Menschen. Häuser, Straßenzüge, Wetterlagen. Szenen aus dem vorweihnachtlichen Alltag, originell zugespitzt, vermeintlich witzig, und doch ... seelenlos. Aus jeder Bildpore drangen unsichtbare, aber offensichtliche Anweisungen von Werbeleuten: noch ein bisschen weniger hiervon, noch viel mehr davon – alles, nur nichts Echtes. Die Reaktionen? Überraschend anti.

Menschen fangen in diesen Zeiten immer mehr an zu spüren und auch zu formulieren, wo etwas unmenschlich und gehaltlos wird. Vielleicht nicht immer. Vielleicht nicht da, wo sie etwas unbedingt glauben möchten. Beim Thema Weihnachten, mit dem oft ganz konkrete Gefühle und Erinnerungen verbunden sind – ob positive oder negative – ging die Entleerung durch KI dann offenbar doch zu weit.

Der Punkt, an dem es kippt

„Hast du das gesehen?“, frage ich meinen 10-jährigen Sohn und zeige ihm ein anderes Video, das gerade viral geht. Er lacht. „Das is’ KI“, sagt er und schaut mich an. „Aber schon lustig…“, fügt er hinzu, vielleicht mit einem Schimmer Mitleid in meine Richtung. Ich bleibe kopfschüttelnd zurück. Mittlerweile bin ich ganz gut darin, KI-generierte Bilder zu erkennen. Dachte ich jedenfalls.

Das Lachen meines Sohnes ist harmlos, fast beiläufig. Doch genau diese beiläufige Sicherheit markiert einen Punkt, an dem etwas kippt.

Bis vor wenigen Monaten ließ sich Echtes noch relativ problemlos von Unechtem unterscheiden. Mit neuesten bildgebenden KIs wie Nano Banana Pro von Google oder Flux 2 von Black Forest Labs verschwimmt diese Trennlinie. Mittlerweile kann die KI auch täuschend echtes Leben. „Digital generierte Personen haben nun einen sympathischen Zahnschiefstand, unregelmäßigen Bartwuchs, freundliche Falten und Körper, die vom Leben geformt zu sein scheinen. Es gibt keinen optischen Unterschied mehr zwischen einem Avatar und einem echten Menschen“, schreibt die Journalistin Rabea Weihser in Die Zeit unter dem Titel „Status: offline“.

Die Ununterscheidbarkeit ist nicht nur ein ästhetisches oder erkenntnistheoretisches Problem – sie wird längst ganz konkret genutzt und missbraucht.

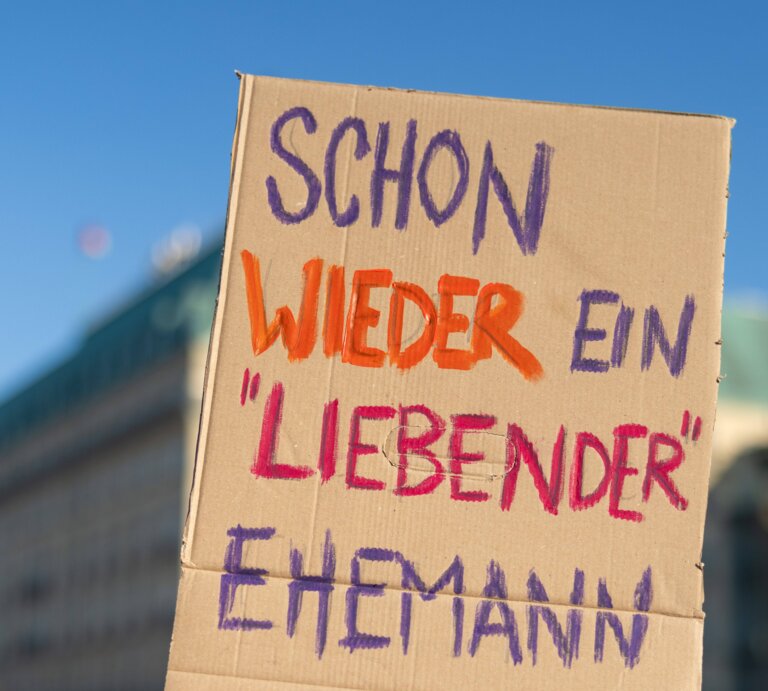

Wie real diese Ununterscheidbarkeit genutzt und missbraucht wird, zeigt sich aktuell besonders perfide auf der Plattform X. Der Bildgenerator Grok Imagine hat einen sogenannten Spicey Mode, dieser Modus erlaubt NSFW-Inhalte (Not Safe For Work), also Inhalte wie Nacktheit, Pornografie, Gewalt, vulgäre Sprache oder andere verstörende Themen. ChatGPT oder Gemini blockieren entsprechende Anfragen. Elon Musk aber sieht hier weniger Probleme und plädiert mit großer Geste für „weniger Zensur und mehr Freiheit“ – und das heißt konkret: Nutzer lassen öffentlich gepostete Fotos sexualisieren und pornografisch verfremden, und zwar massenhaft. Die Opfer: vornehmlich Frauen und Minderjährige. Sie haben keinerlei Möglichkeit, sich zu wehren – und X zieht damit Creator an, die anderswo zensiert würden. Nutzer können zudem ganz einfach Fotos von Kolleg*innen, Mitschüler*innen oder Ex-Partner*innen hochladen, die Bilder bearbeiten und weiterverbreiten.

Der technische Fortschritt hebt hier nicht nur die Grenze zwischen echt und unecht auf, sondern auch jene zwischen Darstellung und Übergriff. „Ein Großteil der Grok-Befehle“, schreibt Der Spiegel am 6. Januar 2026, „scheinen von Männern zu stammen: Mehr als 80 Prozent der Accounts, die in der Studie [von AI Forensics] über Profilbild oder Vornamen einem Geschlecht zugeordnet werden konnten, wurden männlich gelesen.“

Aus Studien des US-Cybersicherheitsunternehmens Home Security Heroes geht hervor, dass 98 Prozent aller Deepfakes weltweit pornografischer Natur sind. Und 99 Prozent der Opfer: Frauen.

Rückschritt durch Fortschritt?

Der Blick auf Videos, Fotos und die durch sie transportierten Nachrichten verändert sich. Er ist zögerlicher, vorsichtiger geworden. Viele Menschen glauben nicht mehr, was sie sehen. Oder besser: Was sie wirklich glauben, wird noch stärker als ohnehin schon bestimmt durch ihre Vorgeschichte, ihre jeweilige Bubble, ihre Gesinnung, ihre unmittelbare Umgebung.

Das führt zu einer Stagnation. Denn das Lernen von anderen, die Verarbeitung neuer Informationen und die verlässliche Einordnung von außen werden untergraben von einem Vertrauensverlust gegenüber vielem, was uns aus den bislang genutzten Informationsquellen erreicht. Die Verwirrung wird perfekt durch den AI-Slop – also den inhaltslosen digitalen Nonsense-Müll, der durch KI superschnell und massenhaft hergestellt wird, Aufmerksamkeit bindet und zum Teil sehr junge Menschen in das schwarze Loch der Belanglosigkeit hineinzieht.

Diese Gemengelage aus Entwertung von Wirklichkeit, Vertrauensverlust und Dauerbeschallung bleibt nicht folgenlos für gesellschaftliche Orientierung.

In der Dokumentation Jung, militant, national - Die Neuen Rechten. werden die Methoden antidemokratischer Organisationen gezeigt, darunter die Jugendorganisation der Kleinpartei „Der Dritte Weg“, die vom Verfassungsschutz als rechtsextremistische, verfassungsfeindliche Organisation eingestuft wird. Sie holt online zunächst vermeintlich unpolitisch insbesondere junge Männer dort ab, wo sie gerade sind: bei der Frage, was sie eigentlich männlich macht: Wer bin ich, wer will ich sein und wie finde ich zu einer Gemeinschaft, die mich akzeptiert?

Viele junge Menschen, insbesondere Männer, sind aus der von Corona ausgelösten Sinn- und Identitätskrise nicht mehr herausgekommen. Rechtsnationale Kräfte nutzen diese Orientierungslosigkeit und schaffen eine „rechtsextreme Gegenwelt zur sozialen Vereinzelung mit tagelangem Daddeln am PC“. In der Doku sehen wir Jugendliche, die sich zum Sportmachen und Kämpfen treffen. Was hier zieht, ist nicht nur Ideologie, sondern das Schaffen echter Erlebnisse jenseits des Internets: gemeinsame Ziele, einfache Antworten. „Tut dies, dann erreicht ihr das. Dann seid ihr glücklich und müsst keine Angst vor der Zukunft haben.“ Natürlich existiert diese Einfachheit nicht – aber es geht um ein Narrativ, das online verbreitet und offline manifestiert wird und dem wir aus der demokratischen Mitte etwas entgegensetzen müssen und können.

KI-Müll, Fake News und permanentes Übertrumpfen

Eine aktuelle Studie von AI Forensics beweist, dass rund ein Viertel der Inhalte unter den beliebtesten Hashtags auf TikTok KI-generiert sind. Die Plattformen markieren KI-generierte Inhalte bislang nur mangelhaft – vor allem TikTok wird von KI-generierten Videos nahezu überschwemmt. Damit verstoßen die Plattformen gegen EU-Regeln und ebnen den Weg für eine Welle automatisierter Desinformation.

Eine ganze Gesellschaft ist durch Dauerbeschallung, KI-Müll, Fake News und das permanente Übertrumpfen von „Hi ihr Lieben“ und „Moinsen, Chat“ zu einem gewaltigen Schädel geronnen, der tief im Schlamassel steckt.

Reset!, könnte man jetzt schreien – aber was dann? Wie möchten wir leben? Was ist uns als Gesellschaft wichtig? Wie kommen wir gemeinsam dahin, wo ein funktionierendes, hass- und hetzefreies, zugewandtes und empathisches Zusammenleben und gegenseitige Fürsorge ermöglicht und wertgeschätzt werden?

Aus meiner Sicht essentiell ist eine bewusste Investition in einen Journalismus, der sich den Clickbait-, KI- und Algorithmus-Spielchen der Social-Media-Giganten entzieht, statt sie weiter zu befeuern. Denn das Bedürfnis nach Echtem ist allgegenwärtig: nach realen Menschen, realen Erfahrungen, realer Verbindung und Repräsentation. Man kann dieses Bedürfnis auch als Chance begreifen – für faktenbasierte Haltungen, für einen wirklich sinnvollen Umgang mit KI und für Geschichten, die nicht optimiert, sondern erlebt sind.

„Vielleicht lenkt der AI-Slop unsere Aufmerksamkeit auf die Bedeutung der analogen Berührung, die sich online durchaus erzählen und nachempfinden lässt.“

Der Journalist Kyle Chayka hat im New Yorker vor dem Hintergrund des „Posting Zero“-Trends geschrieben, dass gerade viele sehr junge User*innen es mittlerweile für sinnlos halten, überhaupt noch Statusmeldungen abzusetzen. „Schon seit einer Weile zahlen Leute für Apps, die ihnen den Zugang zum Internet sperren“, sagt Rabea Weihser in Die Zeit. Und was jetzt nach Rückzug und Erschöpfung aussieht, lässt sich auch anders lesen: als mögliches Innehalten.

Ich bin kein sehr optimistischer Mensch. Und doch: Vielleicht lenkt der AI-Slop unsere Aufmerksamkeit gerade auf die Bedeutung der analogen Berührung – nicht als romantische Gegenwelt, sondern als notwendige Ergänzung zu einer ganzheitlichen, schon in den Schulen vermittelten KI- und Medienkompetenz und zu einer Gesetzgebung, die auch die großen Tech-Giganten ernsthaft und kompromisslos in die Verantwortung nimmt. Erst im Zusammenspiel dieser drei Ebenen könnte eine Vision liegen, die uns wieder näher zusammenbringt.